神戸大学|3年次編入試

神戸大学|3年次編入試 2025年度|神戸大学 編入試解説|理学部数学科|考え方と解答例

2025年度入学の神戸大学理学部数学科の3年次編入試問題の解答例です.4問出題され,全4問を解答します.試験時間は2時間です.

神戸大学|3年次編入試

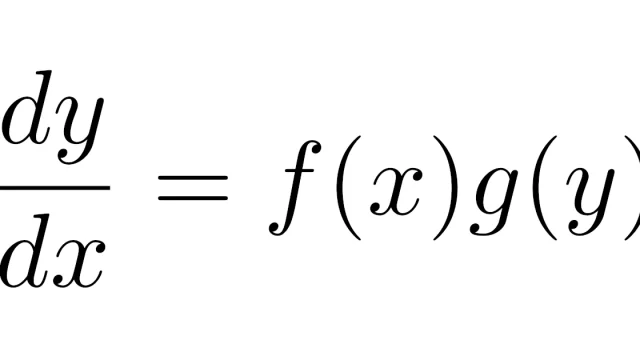

神戸大学|3年次編入試  常微分方程式

常微分方程式  常微分方程式

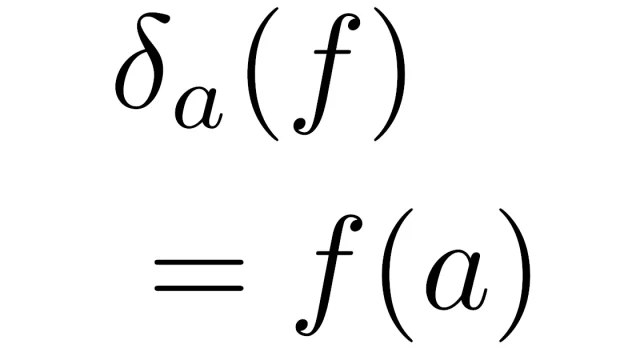

常微分方程式  東京大学|大学院入試

東京大学|大学院入試  京都大学|大学院入試

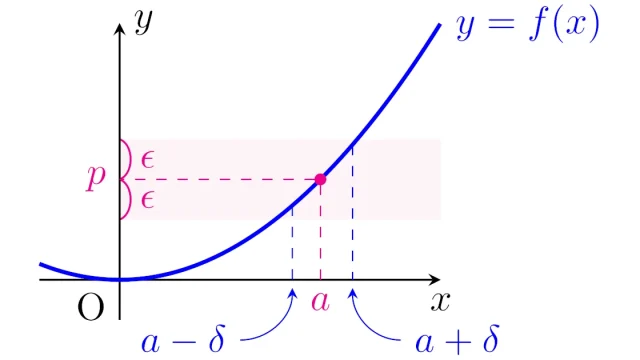

京都大学|大学院入試  微分積分学の基本

微分積分学の基本  京都大学|大学院入試

京都大学|大学院入試  東京大学|大学院入試

東京大学|大学院入試  東京大学|大学院入試

東京大学|大学院入試  関数空間

関数空間